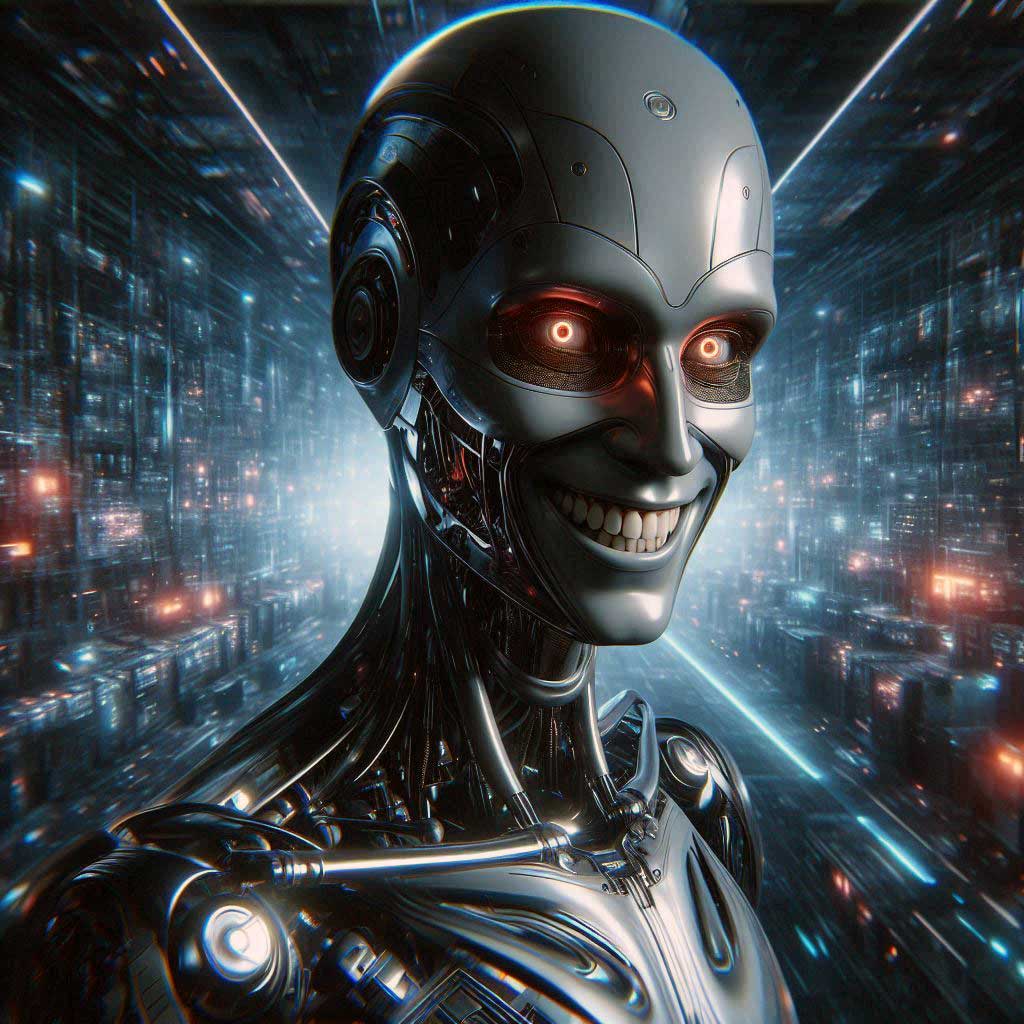

El lado oscuro de la inteligencia artificial, lo que nadie te dice y sobre todo ¿cómo protegerte?

La #InteligenciaArtificial (IA), nos promete productividad y éxito. Llegó para facilitar, mejorar, optimizar y potenciar muchas labores de nuestro día a día. Desde lo laboral, profesional, empresarial, educativo, el hogar, hasta recreación, turismo, finanzas, salud, y muchísimo más. Su buen conocimiento y estrategias de uso pueden generar resultados increíbles en periodos ultra cortos, permitiendo avances en todos los sentidos. Sin embargo, así como puede ser perfecta para cualesquiera que sean nuestros intereses, también puede ser nuestra peor pesadilla en segundos.

Y por las dudas, aclaro que este artículo no narra contras para IA, todo lo contrario, puedo ser su más recio defensor incuso y habrá más adelante artículos que hablen sobre su infinidad de beneficios.

Pero, hoy, la intención es concienciar sobre el cuidado a tener con el uso de esta tecnología y las implicaciones a tener de no hacerlo de buena manera. No es que la IA sea mala o se equivoque, lo que pasa es que según su modelo y estado de conciencia (capacidad de conocimiento adquirido en su entrenamiento), puede “saber” más o “no” y funcionar “mejor” o “no” que otras.

En ese sentido es como suceden las llamadas #alucinaciones de la Inteligencia Artificial, que no son más que respuestas con datos erróneos, inconsistentes o incluso falsos. Precisamente, durante el [lanzamiento](https://lainteligencia.net/article/71) de #ChatGTP5, #OpenAI destacó que las alucinaciones prácticamente desaparecen con su nuevo modelo. Eso no implica que por mal uso o desconocimiento de cómo dar buenas instrucciones no recibamos desde datos sesgos hasta filtraciones, demandas, problemas internos entre muchos riesgos reales. Grandes empresas han enfrentado demandas millonarias por decisiones automatizadas que resultaron discriminatorias.

Como contexto ejemplifico:

El 9 de agosto de 2023, la Comisión para la Igualdad de Oportunidades en el Empleo (EEOC), Estados Unidos, anunció el acuerdo en la primera demanda de la agencia relacionada con el presunto uso discriminatorio de la inteligencia artificial (IA) en el lugar de trabajo. En la demanda, EEOC contra iTutorGroup, Inc., la [EEOC alegó que el software de contratación de iTutorGroup rechazaba automáticamente](https://www.reuters.com/legal/tutoring-firm-settles-us-agencys-first-bias-lawsuit-involving-ai-software-2023-08-10/) a los solicitantes de empleo mayores de edad, en violación de la Ley contra la Discriminación por Edad en el Empleo (ADEA), sentando un precedente al respecto. En otro caso, en el mismo país en mención, una empresa tecnológica implementó un chatbot basado en IA para atender a sus clientes.

Durante semanas, el bot empezó a dar respuestas ofensivas sin que nadie lo notara, pero en cierto momento un cliente lo hizo viral en redes sociales; el daño a la reputación y la pérdida de contratos fue devastador. Confiar ciegamente en la IA, delegando tareas críticas sin supervisión humana puede ser un desastre reputacional, legal y financiero.

Por eso, aplicar buenas prácticas con su uso es una necesidad conciente.

Cómo evitar que la IA se nos salga "de control":

- Protege tu privacidad: Nunca introduzcas datos confidenciales (como nombres de clientes, contratos o datos bancarios) en herramientas de IA sin políticas claras de seguridad.

- Supervisión humana: Usa la IA como apoyo, pero mantén la decisión final bajo tu control. La IA es excelente para sugerir, no para decidir por ti en contextos críticos.

- Infórmate sobre leyes y regulaciones: La legislación sobre IA y protección de datos está evolucionando. En Europa, por ejemplo, el AI Act. impondrá fuertes restricciones y multas a usos indebidos.

- Capacita a tu equipo: No basta con que tú conozcas los riesgos. Enseña a quienes trabajan contigo a detectar señales de alerta y usar la IA de forma responsable.

La IA es poderosa, pero recuerda que no es infalible. Adoptar un enfoque consciente, ético y seguro te permitirá aprovecharla al máximo sin poner en riesgo tu negocio, tu reputación ni la confianza de tus clientes.

¡Mejora tu día a día utilizando Inteligencia Artificial! ¡Pura vida!